Source: The Conversation – France in French (2) – By Shinichi Sunagawa, Associate Professor at the Department of Biology, Swiss Federal Institute of Technology Zurich

Depuis des décennies, nous voyons les récifs coralliens comme les « forêts tropicales aquatiques » : des écosystèmes colorés et complexes regorgeant de poissons, d’éponges et de coraux. Cependant, nos recherches récentes suggèrent que cette vision passe sous silence un aspect crucial des récifs coralliens. Au-delà de leurs couleurs si vivaces, ils abritent tout un monde microscopique. Cet univers caché se compose de nombreux ingénieurs chimistes, qui pourraient détenir les clés d’une prochaine génération de médicaments vitaux.

Nos travaux, publiés aujourd’hui dans Nature, fruit d’une collaboration internationale entre mon laboratoire et ceux des professeurs Paoli et Piel avec la Fondation Tara Océan, montrent que les coraux ne sont pas de « simples » animaux individuels, mais plutôt des « super-organismes ». On pourrait les imaginer comme des villes animées où le récif corallien fournit un habitat vivant à des milliards de microbes qui y accomplissent des fonctions vitales.

Ce que nous avons découvert au sein de ces communautés microscopiques nous a stupéfiés : en analysant 820 échantillons provenant de 99 récifs coralliens à travers le Pacifique, nous avons reconstitué le génome de 645 espèces microbiennes vivant dans les coraux… dont plus de 99 % étaient totalement inconnues.

Qui plus est, nos études génétiques montrent que ces minuscules résidents ne sont pas passifs, mais des ingénieurs chimistes prolifiques : ils abritent dans leur ADN une immense variété de « plans » biosynthétiques (qui visent la formation de composés chimiques par des êtres vivants, des bactéries par exemple). Cette variété est plus grande que ce qui a été documenté jusqu’à présent dans l’ensemble des océans du monde.

Comment avons-nous fait cette découverte ?

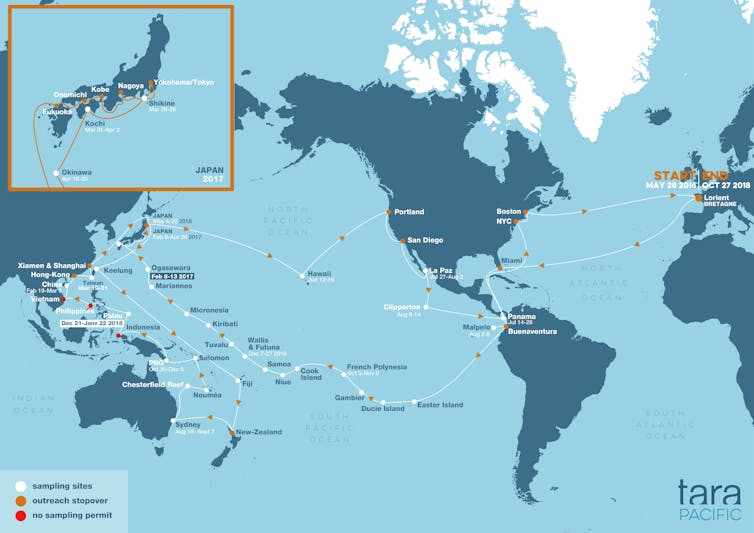

Notre découverte a commencé à bord de la goélette de recherche Tara, longue de 36 mètres et conçue pour résister à la glace arctique. Après avoir mené une exploration approfondie du plancton dans les océans du globe, Tara nous a servi de laboratoire flottant pour la mission Tara Pacific. Pendant plusieurs années, notre équipe a visité 99 récifs à travers le Pacifique. La vie à bord de Tara, c’est l’unique combinaison d’une navigation pas toujours paisible et d’une biologie high tech : tandis que l’équipage gérait le navire, des équipes de plongeurs collectaient des échantillons de coraux dans des archipels éloignés de plusieurs milliers de kilomètres.

tara, Fourni par l’auteur

De retour à terre, un vrai travail de détective a commencé. Le séquençage de l’ADN au Centre National de Séquençage français (Genoscope) et la reconstruction des génomes à l’aide des supercalculateurs de l’ETH Zurich nous ont permis de décoder les informations génétiques des microbes coralliens.

Ainsi est apparue une carte des microbiomes coralliens du Pacifique, à une échelle inédite. Nous avons découvert que les microbes sont très spécifiques à leurs hôtes coralliens ; chaque espèce de corail possède sa propre empreinte microbienne façonnée au cours de millions d’années d’évolution.

En quoi cette découverte est-elle importante ?

La plupart des médicaments actuels ont été découverts dans la nature, le plus souvent à partir de bactéries du sol. Mais aujourd’hui, les bactéries résistantes aux antibiotiques constituent une menace mondiale croissante et nous sommes à court de nouvelles pistes dans le sol.

À lire aussi :

De la médecine traditionnelle au traitement du cancer : le fabuleux destin de la pervenche de Madagascar

C’est là que les minuscules mais puissants « ingénieurs chimistes » des récifs coralliens prennent toute leur importance en termes d’applications potentielles. Dans leur ADN, ces microbes codent des ensembles de gènes biosynthétiques : des manuels d’instructions pour construire diverses molécules biochimiques, y compris des antibiotiques.

En effet, comme les microbes associés aux coraux vivent dans l’environnement hautement compétitif des récifs, ils ont développé des armes chimiques sophistiquées pour défendre leurs hôtes ou combattre leurs rivaux. En identifiant ces ensembles de gènes biosynthétiques, nous avons donc découvert une « bibliothèque moléculaire » écrite dans un langage que nous commençons seulement à traduire. Ces substances chimiques pourraient peut-être apporter des solutions aux défis biotechnologiques et aux maladies humaines.

Quelle est la prochaine étape ?

Notre découverte de nouvelles espèces microbiennes et de la diversité biochimique des coraux n’est qu’un début. L’expédition Tara Pacific n’a étudié qu’une poignée d’espèces de coraux, alors qu’au moins 1500 ont été décrites dans le monde entier, ce qui suggère un énorme potentiel de percées scientifiques.

Mais une tragédie est en train de se dérouler : à mesure que le changement climatique réchauffe les océans, les récifs coralliens meurent. Lorsqu’un récif disparaît, nous ne perdons pas seulement un magnifique écosystème, nous assistons à la « combustion » de cette bibliothèque, avant même d’avoir eu la chance d’en lire les livres.

Le voyage qui a commencé sur Tara est désormais une course contre la montre pour percer les secrets contenus dans les microbiomes des coraux et autres organismes récifaux avant qu’ils ne disparaissent à jamais. Il est essentiel de protéger les récifs, non seulement pour l’environnement et les millions de personnes qui en dépendent directement, mais aussi pour préserver la pharmacie biologique qui pourrait protéger la santé humaine pour les générations à venir.

![]()

Shinichi Sunagawa a reçu des financements de la Swiss National Science Foundation.

Chris Bowler ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d’une organisation qui pourrait tirer profit de cet article, et n’a déclaré aucune autre affiliation que son organisme de recherche.

– ref. Lever le voile sur les microbiotes inconnus des coraux du Pacifique à bord de Tara – https://theconversation.com/lever-le-voile-sur-les-microbiotes-inconnus-des-coraux-du-pacifique-a-bord-de-tara-276891